新时代的“电老虎”,聚焦于聚能与散热的AI智能

发布时间:2023.11.13 浏览次数:218次

AI,是新时代人们追捧的“弄潮儿”。不论是元宇宙,还是无人智能驾驶,亦或是时下热门的ChatGPT,都是智能AI的细分领域应用。不同企业的AI算法机制不一样,导致AI应用效果也良莠不齐。

“电老虎”的诞生

若将AI比作初入学堂的学生,那么AI需要不停地学习和测试,才能成为人们眼中的优等生。AI模型在内测期间需要不停地进行演算测试,而测试过程需要消耗大量的能量。

据统计,单个大型AI模型在内测期间测试需要消耗43.3万kW·h,而人们熟知的ChatGPT,内测期间需要消耗128.7万kW·h。然而,这仅仅只是AI内测期间需要消耗的能量。

当AI正式推出市场,被海量用户接受并使用时,其耗费的能量更是天文数字。以ChatGPT 为例,日均最高访问量为2.7亿次,每个人每次5个问题,一个月能量消耗高达1872万kW·h。

另外,随着AI领域的兴起,不少企业开始进入AI赛道内卷,百度的文心一言、阿里的通义千问、腾讯的混元等AI模型的问世,进一步增大AI的能量消耗。当AI市场发展到后期,为了更好地抢占市场,这些企业对己方的AI模型进行优化,在优化过程中又会产生海量的能量消耗。

聚能与散能

数据中心是AI运行的物理场所,AI无法脱离数据中心服务器。热力学第二定律的存在,决定了数据中心服务器能量转化率没法达到100%。

服务器运行过程,部分电能转化为热量。450㎡的数据中心,额定功率为250kw,做功功率为75kw,总发热量可达108kw,约为设备做功功率的1.5倍。

为了保证数据中心正常高效运转,数据中心必须通过使用同样消耗能源的冷却设备祛除热量,这又给AI增加了一笔额外能耗支出。

部分企业为了降低能源消耗,选择各种散热方式。在《原生态降温?企业为何热衷将数据中心投入大自然》一文提到,部分企业选择将数据中心建造在气候温度条件稳定的自然环境,利用天然的稳定低温气候条件对数据中心进行温度调节,将数据中心产生的热量释放出去,以保证数据中心的正常运行。

为了更高效散热,部分企业选择液冷散热方式。如阿里在在千岛湖建立的数据中心,就是利用深层湖水对服务器进行降温。如今,由于技术的发展,液冷技术受到产业高度关注,众多厂商围绕液冷“新战场”展开新的角逐。液冷散热市场的渗透率也达到5%~8%。

不论哪种散热方式,当AI数据中心发生故障(如电气设备短路、老化),产生的热量超过散热系统的设计冗余;或散热系统发生故障,产生的热量未能及时充分排放出去,导致热量堆积,长期将会降低数据中心的效率,甚至造成数据中心的损毁。

因此,热量交换系统需要保有足够的冗余进行热量宣泄,或采用安全预警系统对电气设备进行安全监测。

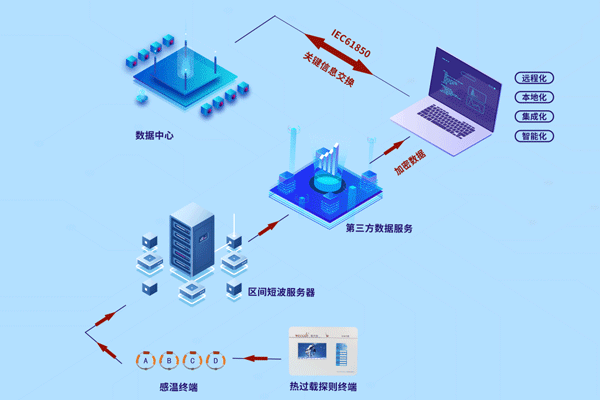

如查知科技的热过载定位安全监测系统,能够发现物质异常受热,及时发出报警信息,为排查物质异常过热特别是电气热过载争取了宝贵时间,解决电气设备热过载预警难题。

该系统采用云室热释离子探测技术,利用物质受热且受损产生的热释离子进行分析计算,解决了常规探测器受探测物质材质复杂度影响探测失准的难题。而且该系统为吸气式探测取样法,可以保证复杂场所下的探测效果。

系统还搭配了先进的定位系统,定位精度可达50mm,可以精准锁定发生热过载的部件,为智能AI发展保驾护航,免除后顾之忧。

相关新闻